クラウドサービスのニーズを満たすため、ネットワークは徐々にアンダーレイとオーバーレイに分割されてきました。アンダーレイネットワークは、従来のデータセンターにおけるルーティングやスイッチングなどの物理機器で構成され、安定性を重視し、信頼性の高いネットワークデータ伝送機能を提供します。一方、オーバーレイは、VXLANやGREプロトコルによるカプセル化を通じてサービスに近いビジネスネットワークをカプセル化し、ユーザーに使いやすいネットワークサービスを提供します。アンダーレイネットワークとオーバーレイネットワークは、互いに関連しながらも分離されており、それぞれ独立して進化することができます。

アンダーレイネットワークはネットワークの基盤となるものです。アンダーレイネットワークが不安定な場合、ビジネスに対するSLAは適用されません。3層ネットワークアーキテクチャとファットツリーネットワークアーキテクチャに続き、データセンターネットワークアーキテクチャはスパインリーフアーキテクチャへと移行しており、これによりCLOSネットワークモデルの3番目の適用が実現しました。

従来のデータセンターネットワークアーキテクチャ

三層構造

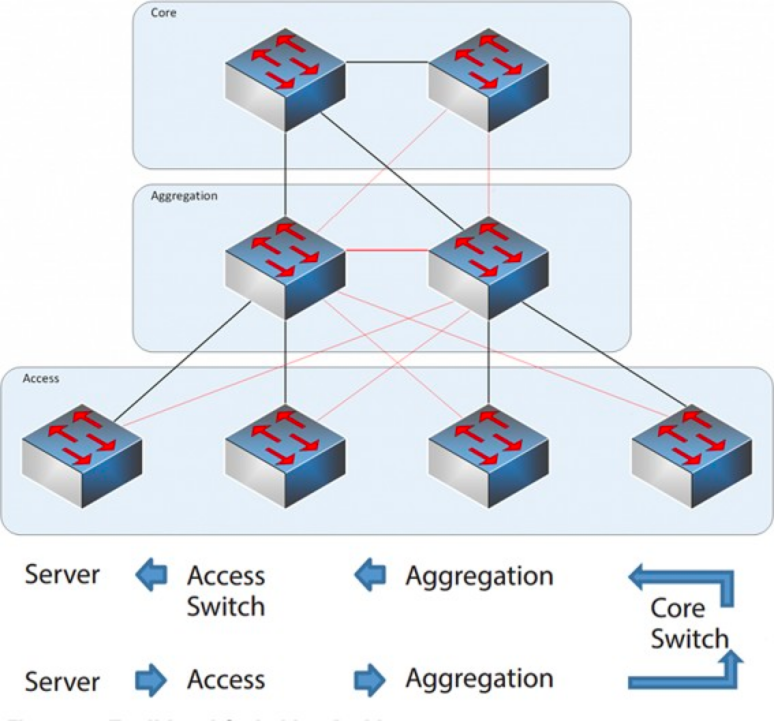

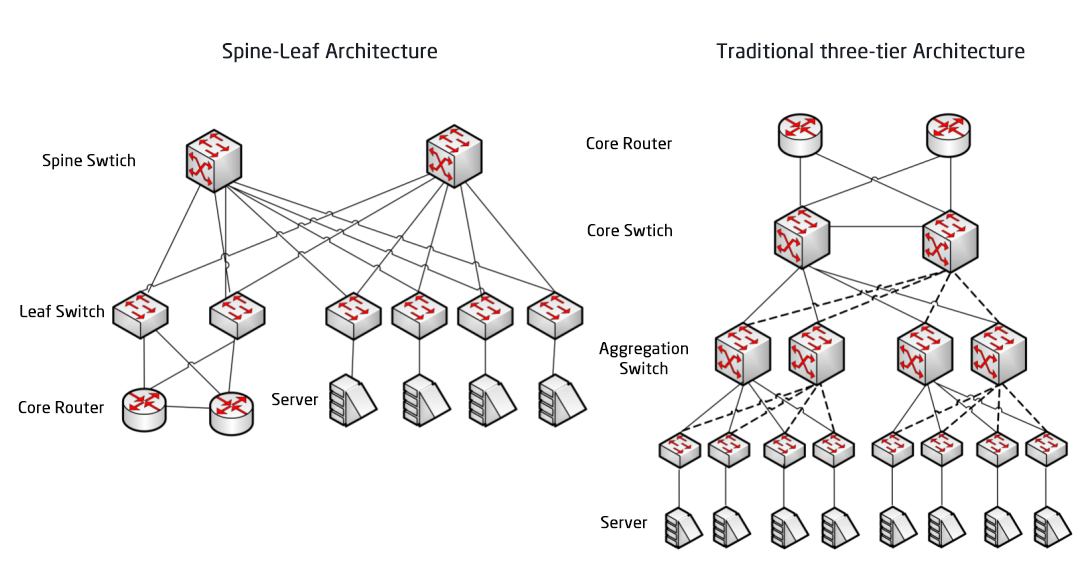

2004年から2007年にかけて、3層ネットワークアーキテクチャはデータセンターで非常に人気がありました。このアーキテクチャは、コア層(ネットワークの高速スイッチングバックボーン)、アグリゲーション層(ポリシーベースの接続を提供する)、アクセス層(ワークステーションをネットワークに接続する)の3つの層で構成されています。モデルは次のとおりです。

3層ネットワークアーキテクチャ

コア層:コアスイッチは、データセンター内外へのパケットの高速転送、複数の集約層への接続、および通常はネットワーク全体をカバーする堅牢なL3ルーティングネットワークを提供します。

集約レイヤー:集約スイッチはアクセススイッチに接続され、ファイアウォール、SSLオフロード、侵入検知、ネットワーク分析などの他のサービスを提供します。

アクセス層:アクセススイッチは通常ラックの上部に配置されるため、ToR(Top of Rack)スイッチとも呼ばれ、物理的にサーバーに接続されます。

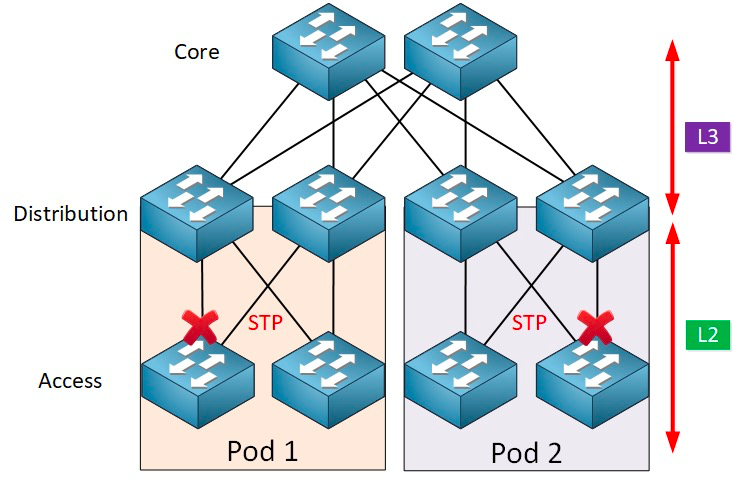

通常、アグリゲーションスイッチはL2ネットワークとL3ネットワークの境界点となります。L2ネットワークはアグリゲーションスイッチの下に位置し、L3ネットワークは上に位置します。各アグリゲーションスイッチのグループは、ポイントオブデリバリー(POD)を管理し、各PODは独立したVLANネットワークです。

ネットワークループとスパニングツリープロトコル

ループの発生は、主に宛先パスが不明確であることによる混乱が原因です。ユーザーはネットワーク構築時に信頼性を確保するために冗長なデバイスやリンクを使用することが多いため、ループは必然的に発生します。レイヤ2ネットワークは同じブロードキャストドメインに属しており、ループ内でブロードキャストパケットが繰り返し送信されることでブロードキャストストームが発生し、ポートの閉塞や機器の麻痺を瞬時に引き起こす可能性があります。したがって、ブロードキャストストームを防ぐためには、ループの発生を防ぐ必要があります。

ループの発生を防ぎ、信頼性を確保するためには、冗長デバイスと冗長リンクをバックアップデバイスとバックアップリンクとしてのみ機能させる必要があります。つまり、冗長デバイスのポートとリンクは通常の状態ではブロックされ、データパケットの転送には関与しません。現在の転送デバイス、ポート、リンクに障害が発生し、ネットワークが輻輳した場合にのみ、冗長デバイスのポートとリンクが開かれ、ネットワークが正常な状態に復旧されます。この自動制御は、スパニングツリープロトコル(STP)によって実現されます。

スパニングツリープロトコルは、アクセス層とシンク層の間で動作し、その中核となるのは、各STP対応ブリッジ上で実行されるスパニングツリーアルゴリズムです。このアルゴリズムは、冗長なパスが存在する場合にブリッジングループを回避するように特別に設計されています。STPは、メッセージ転送に最適なデータパスを選択し、スパニングツリーの一部ではないリンクを禁止します。これにより、任意の2つのネットワークノード間には1つのアクティブなパスのみが残り、もう一方のアップリンクはブロックされます。

STPには多くの利点があります。シンプルで、プラグアンドプレイ方式であり、設定もほとんど必要ありません。各ポッド内のマシンは同じVLANに属しているため、サーバーはIPアドレスやゲートウェイを変更することなく、ポッド内で場所を自由に移動できます。

しかし、STPでは並列転送パスを使用できず、VLAN内の冗長パスは常に無効になります。STPの欠点:

1. トポロジーの収束が遅い。ネットワークトポロジーが変化すると、スパニングツリープロトコルがトポロジーの収束を完了するのに50~52秒かかります。

2. 負荷分散機能を提供できません。ネットワークにループが発生した場合、スパニングツリープロトコルは単純にループをブロックすることしかできず、リンクがデータパケットを転送できなくなるため、ネットワークリソースが無駄になります。

仮想化と東西トラフィックの課題

2010年以降、コンピューティングおよびストレージリソースの利用効率を向上させるため、データセンターは仮想化技術を採用し始め、ネットワーク上に多数の仮想マシンが出現するようになりました。仮想化技術は、1台のサーバーを複数の論理サーバーに変換し、各仮想マシンは独立して動作し、独自のOS、アプリケーション、MACアドレス、IPアドレスを持ち、サーバー内部の仮想スイッチ(vSwitch)を介して外部エンティティに接続します。

仮想化には、仮想マシンのライブマイグレーションという付随的な要件があります。これは、仮想マシン上のサービスの正常な動作を維持しながら、仮想マシンのシステムをある物理サーバーから別の物理サーバーに移行できる機能です。このプロセスはエンドユーザーに影響を与えず、管理者はユーザーの通常の利用に影響を与えることなく、サーバーリソースを柔軟に割り当てたり、物理サーバーの修理やアップグレードを行ったりすることができます。

移行中にサービスが中断されないようにするためには、仮想マシンのIPアドレスが変更されないだけでなく、仮想マシンの実行状態(TCPセッション状態など)も移行中に維持される必要があります。そのため、仮想マシンの動的移行は同一のレイヤ2ドメイン内でのみ実行可能であり、レイヤ2ドメインをまたいだ移行はできません。このため、アクセスレイヤからコアレイヤにかけて、より大きなレイヤ2ドメインが必要となります。

従来の大規模レイヤ2ネットワークアーキテクチャでは、L2とL3の境界はコアスイッチにあり、コアスイッチの下にあるデータセンターは完全なブロードキャストドメイン、つまりL2ネットワークとなっています。この方式では、デバイスの配置や場所の移動を自由に行うことができ、IPやゲートウェイの設定を変更する必要もありません。異なるL2ネットワーク(VLAN)はコアスイッチを経由してルーティングされます。しかし、このアーキテクチャではコアスイッチが膨大なMACおよびARPテーブルを維持する必要があり、コアスイッチの能力に高い要求が課せられます。さらに、アクセススイッチ(TOR)もネットワーク全体の規模を制限します。これらは最終的にネットワークの規模、ネットワークの拡張性、弾力性を制限し、3層間のスケジューリングの遅延問題を引き起こし、将来のビジネスニーズを満たすことができません。

一方、仮想化技術によってもたらされる東西方向のトラフィックは、従来の3層ネットワークにも課題をもたらしている。データセンターのトラフィックは、大きく以下のカテゴリに分類できる。

南北交通:データセンター外部のクライアントとデータセンターサーバー間のトラフィック、またはデータセンターサーバーからインターネットへのトラフィック。

東西交通:データセンター内のサーバー間のトラフィック、および異なるデータセンター間のトラフィック(データセンター間の災害復旧、プライベートクラウドとパブリッククラウド間の通信など)。

仮想化技術の導入により、アプリケーションの展開はますます分散化され、その「副作用」として東西間のトラフィックが増加している。

従来の3層構造の建築物は、一般的に南北方向の交通を想定して設計されている。東西方向の通信には使用できるものの、最終的には要求される性能を発揮できない可能性がある。

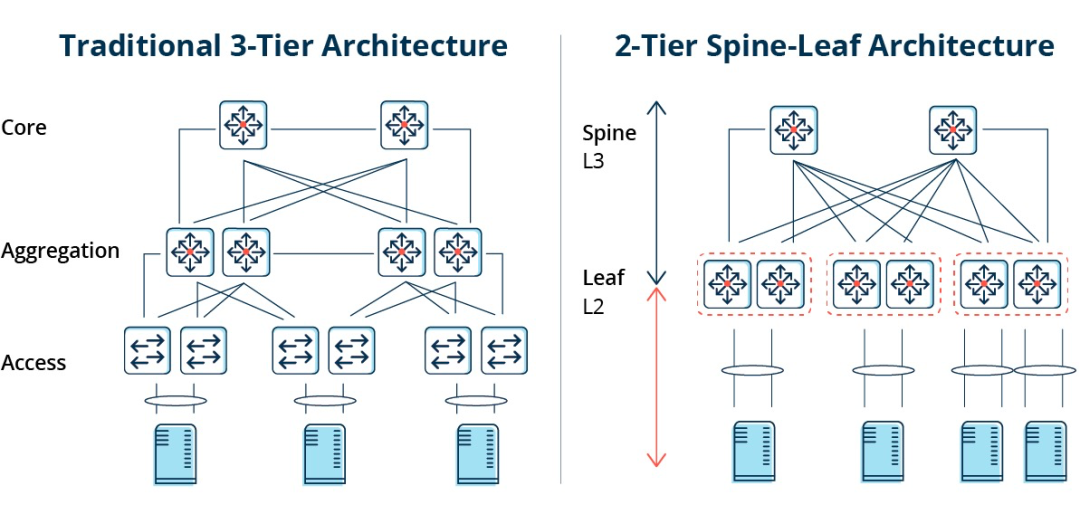

伝統的な3層構造建築とスパインリーフ構造建築の比較

3層アーキテクチャでは、東西方向のトラフィックは集約層とコア層のデバイスを経由して転送される必要があります。これは、不必要に多くのノードを経由することになります。(サーバー→アクセス→集約→コアスイッチ→集約→アクセススイッチ→サーバー)

したがって、大量の東西トラフィックが従来の3層ネットワークアーキテクチャを通過する場合、同じスイッチポートに接続されたデバイス間で帯域幅の競合が発生し、エンドユーザーの応答時間が悪化する可能性がある。

従来の3層ネットワークアーキテクチャの欠点

従来の3層ネットワークアーキテクチャには多くの欠点があることがわかる。

帯域幅の無駄遣い:ループを防ぐために、STPプロトコルは通常、集約層とアクセス層の間で実行され、アクセススイッチのアップリンクのうち1つだけが実際にトラフィックを伝送し、他のアップリンクはブロックされるため、帯域幅の無駄遣いを防ぐことができます。

大規模ネットワーク配置の難しさ:ネットワーク規模の拡大に伴い、データセンターは地理的に分散し、仮想マシンはあらゆる場所に作成・移行される必要があり、IPアドレスやゲートウェイなどのネットワーク属性は変更されないため、ファットレイヤー2のサポートが不可欠となります。従来の構造では、このような移行は実行できません。

東西方向の交通量の不足:3層ネットワークアーキテクチャは主に南北方向のトラフィック向けに設計されていますが、東西方向のトラフィックもサポートしています。しかし、その欠点は明らかです。東西方向のトラフィックが大きくなると、集約層とコア層のスイッチへの負荷が大幅に増加し、ネットワークの規模と性能は集約層とコア層によって制限されます。

これにより、企業はコストと拡張性のジレンマに陥る。大規模で高性能なネットワークを支えるには、多数のコンバージェンス層およびコア層機器が必要となり、企業にとって高コストになるだけでなく、ネットワーク構築時に事前の計画が不可欠となります。ネットワーク規模が小さい場合はリソースの無駄遣いにつながり、ネットワーク規模が拡大し続けると拡張が困難になります。

スパインリーフネットワークアーキテクチャ

スパインリーフ型ネットワークアーキテクチャとは何ですか?

上記の問題に対応するため、新しいデータセンター設計として、スパインリーフ型ネットワークアーキテクチャが登場しました。これは、私たちがリーフリッジネットワークと呼んでいるものです。

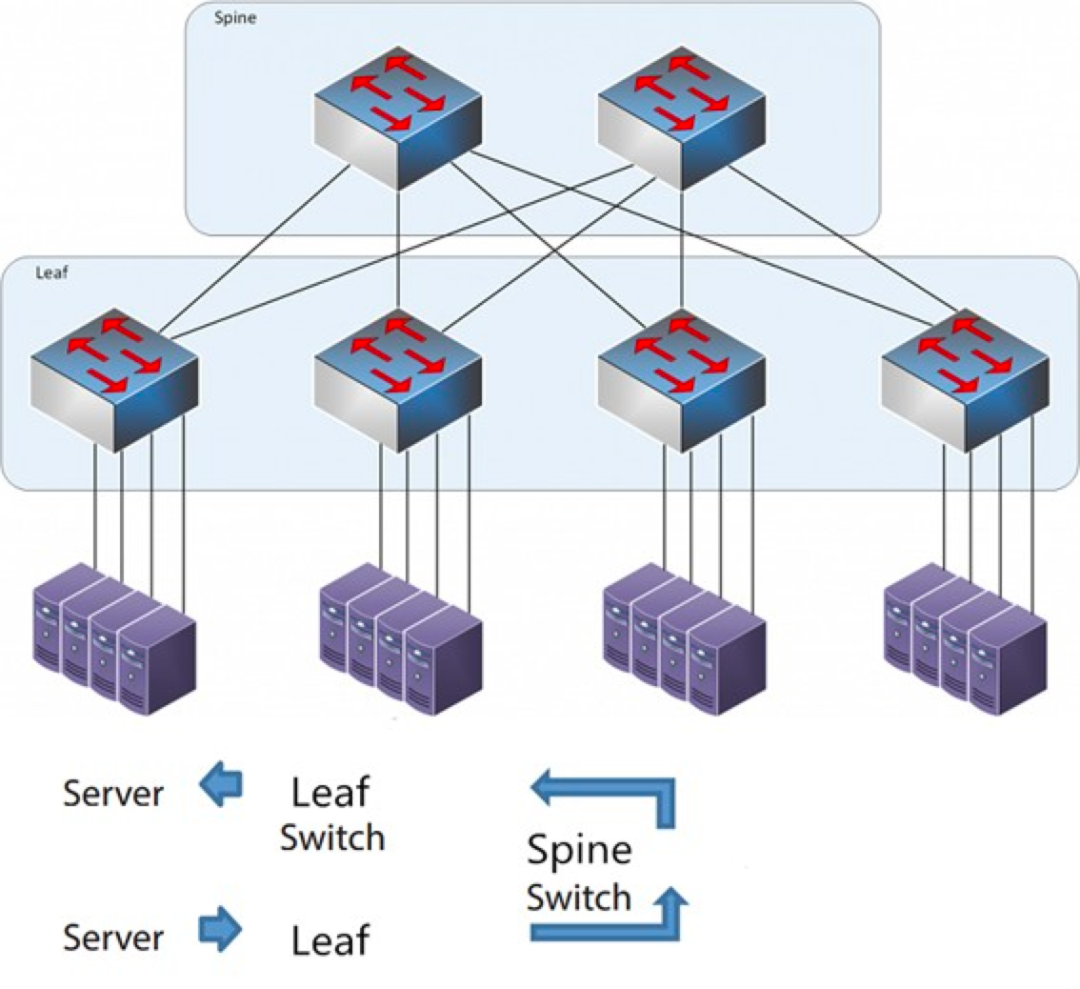

その名の通り、このアーキテクチャはスパイン層とリーフ層から構成され、スパインスイッチとリーフスイッチが含まれています。

背骨と葉の構造

各リーフスイッチはすべてのリッジスイッチに接続されており、リッジスイッチ同士は直接接続されていないため、フルメッシュトポロジーが形成される。

スパインアンドリーフ構成では、あるサーバーから別のサーバーへの接続は、同じ数のデバイス(サーバー→リーフ→スパインスイッチ→リーフスイッチ→サーバー)を経由するため、予測可能な遅延が保証されます。パケットは、宛先に到達するために、1つのスパインと別のリーフを経由するだけで済むためです。

Spine-Leafの仕組みとは?

リーフスイッチ:従来の3層アーキテクチャにおけるアクセススイッチに相当し、TOR(トップオブラック)として物理サーバーに直接接続されます。アクセススイッチとの違いは、L2/L3ネットワークの境界点がリーフスイッチにある点です。リーフスイッチは3層ネットワークの上に位置し、独立したL2ブロードキャストドメインの下に位置するため、大規模な2層ネットワークのBUM問題を解決します。2台のリーフサーバーが通信する必要がある場合は、L3ルーティングを使用してスパインスイッチ経由で転送する必要があります。

スパインスイッチ:コアスイッチと同等の役割を果たします。ECMP(等コストマルチパス)を使用して、スパインスイッチとリーフスイッチ間の複数のパスを動的に選択します。違いは、スパインスイッチがリーフスイッチに対して冗長性の高いL3ルーティングネットワークを提供するだけであり、データセンターの南北トラフィックは直接ではなくスパインスイッチを経由してルーティングされる点です。南北トラフィックは、リーフスイッチと並行するエッジスイッチからWANルーターへルーティングできます。

スパイン/リーフ型ネットワークアーキテクチャと従来の3層ネットワークアーキテクチャの比較

スパインリーフの利点

フラット:フラットな設計はサーバー間の通信経路を短縮し、レイテンシを低減するため、アプリケーションとサービスのパフォーマンスを大幅に向上させることができます。

優れた拡張性:帯域幅が不足している場合は、リッジスイッチの数を増やすことで帯域幅を水平方向に拡張できます。サーバー数が増加し、ポート密度が不足している場合は、リーフスイッチを追加できます。

コスト削減:北行きおよび南行きのトラフィックは、リーフノードまたはリッジノードから出力されます。東西方向のトラフィックは、複数のパスに分散されます。このようにして、リーフリッジネットワークは、高価なモジュール式スイッチを必要とせずに固定構成スイッチを使用できるため、コストを削減できます。

低遅延と輻輳回避:リーフリッジネットワークにおけるデータフローは、送信元と宛先に関わらず、ネットワーク全体で同じホップ数を持ち、任意の2つのサーバーはリーフ→スパイン→リーフの3ホップで相互に到達可能です。これにより、より直接的なトラフィックパスが確立され、パフォーマンスが向上し、ボトルネックが軽減されます。

高いセキュリティと可用性:STPプロトコルは従来の3層ネットワークアーキテクチャで使用され、デバイスに障害が発生すると再収束するため、ネットワークのパフォーマンスに影響を与えたり、ネットワークがダウンしたりする可能性があります。一方、リーフリッジアーキテクチャでは、デバイスに障害が発生しても再収束の必要はなく、トラフィックは他の通常のパスを通って流れ続けます。ネットワーク接続は影響を受けず、帯域幅は1つのパス分だけ減少するため、パフォーマンスへの影響はほとんどありません。

ECMPによる負荷分散は、SDNなどの集中型ネットワーク管理プラットフォームが使用される環境に最適です。SDNは、遮断やリンク障害が発生した場合のトラフィックの設定、管理、再ルーティングを簡素化するため、インテリジェントな負荷分散フルメッシュトポロジーを比較的簡単に設定および管理できます。

しかし、スパインリーフアーキテクチャにはいくつかの制限がある。

欠点の1つは、スイッチの数が増えるとネットワークの規模が大きくなることです。リーフリッジネットワークアーキテクチャのデータセンターでは、クライアント数に比例してスイッチやネットワーク機器を増やす必要があります。ホスト数が増加するにつれて、リッジスイッチへのアップリンクに必要なリーフスイッチの数も増加します。

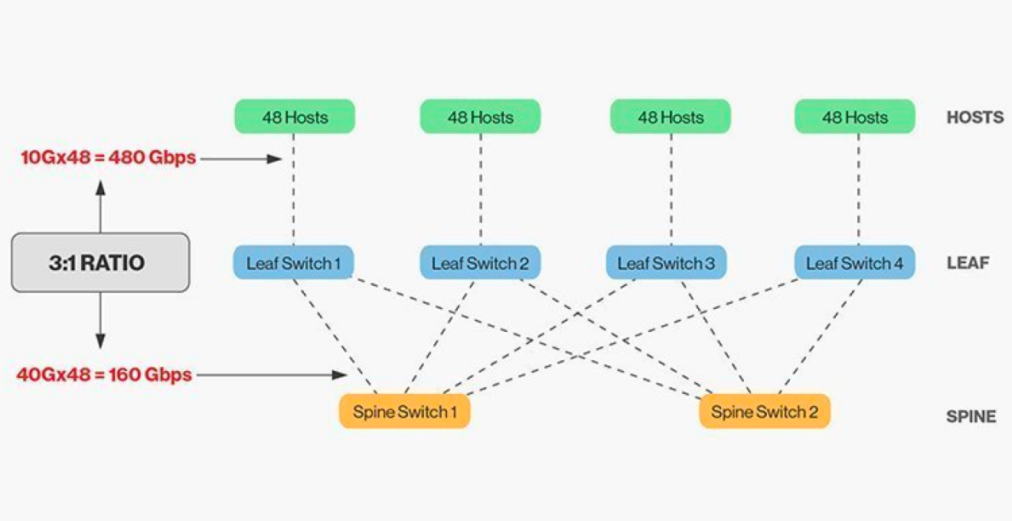

リッジスイッチとリーフスイッチを直接接続するには、マッチングが必要であり、一般的に、リーフスイッチとリッジスイッチ間の適切な帯域幅比は3:1を超えてはならない。

例えば、リーフスイッチには合計ポート容量が480Gb/sの10Gbpsレートのクライアントが48台接続されています。各リーフスイッチの4つの40Gアップリンクポートを40Gリッジスイッチに接続すると、アップリンク容量は160Gb/sになります。比率は480:160、つまり3:1です。データセンターのアップリンクは通常40Gまたは100Gで、開始点である40G(Nx 40G)から100G(Nx 100G)へと時間をかけて移行できます。ポートリンクをブロックしないように、アップリンクは常にダウンリンクよりも高速で動作する必要があることに注意してください。

スパインリーフネットワークには、明確な配線要件があります。各リーフノードは各スパインスイッチに接続する必要があるため、より多くの銅線または光ファイバーケーブルを敷設する必要があります。相互接続距離が長くなるとコストも上昇します。相互接続されたスイッチ間の距離によっては、スパインリーフアーキテクチャで必要となるハイエンド光モジュールの数は、従来の3層アーキテクチャの数十倍にもなり、全体的な導入コストが増加します。しかし、このことが光モジュール市場、特に100Gや400Gといった高速光モジュール市場の成長につながっています。

投稿日時:2026年1月26日